- EFF заявила, что блокировка Интернет-архива со стороны издателей не остановит ИИ-скрейперов, но может лишить сеть исторических записей.

- Поводом стали действия крупных СМИ: The New York Times уже ограничила индексацию сайта архивом с помощью мер строже, чем стандартный robots.txt.

- Организация предупреждает, что если эта практика распространится, пользователи могут потерять доступ к сохранённым версиям статей за почти три десятилетия веб-истории.

Фонд электронных рубежей (EFF) предупредил, что ограничения на доступ Интернет-архива к сайтам СМИ могут начать стирать историческую память веба. Об этом написал старший аналитик по вопросам политики EFF Джо Маллин в публикации от марта 2026 года. По его словам, если издатели закрывают архивным ботам доступ к своим страницам, это бьёт не по ИИ-компаниям, а по цифровым библиотекам, которые сохраняют материалы для журналистов, исследователей и обычных читателей.

Маллин сравнил ситуацию с запретом библиотекам хранить бумажные выпуски газет. Он напомнил, что Интернет-архив с середины 1990-х годов собирает и хранит копии веб-страниц, включая новостные сайты. Такие копии важны не только для истории: они позволяют увидеть, как материал выглядел на момент публикации, если позже текст исправили, сократили или удалили.

По данным EFF, в последние месяцы The New York Times стала блокировать индексацию своего сайта со стороны архива, используя технические меры, которые выходят за пределы обычных правил robots.txt — файла с инструкциями для поисковых и архивных ботов. Похожие шаги, как пишет Маллин, похоже, предпринимают и другие издания, включая The Guardian. Издатели объясняют это защитой контента от скрейперов, которые собирают данные для обучения ИИ.

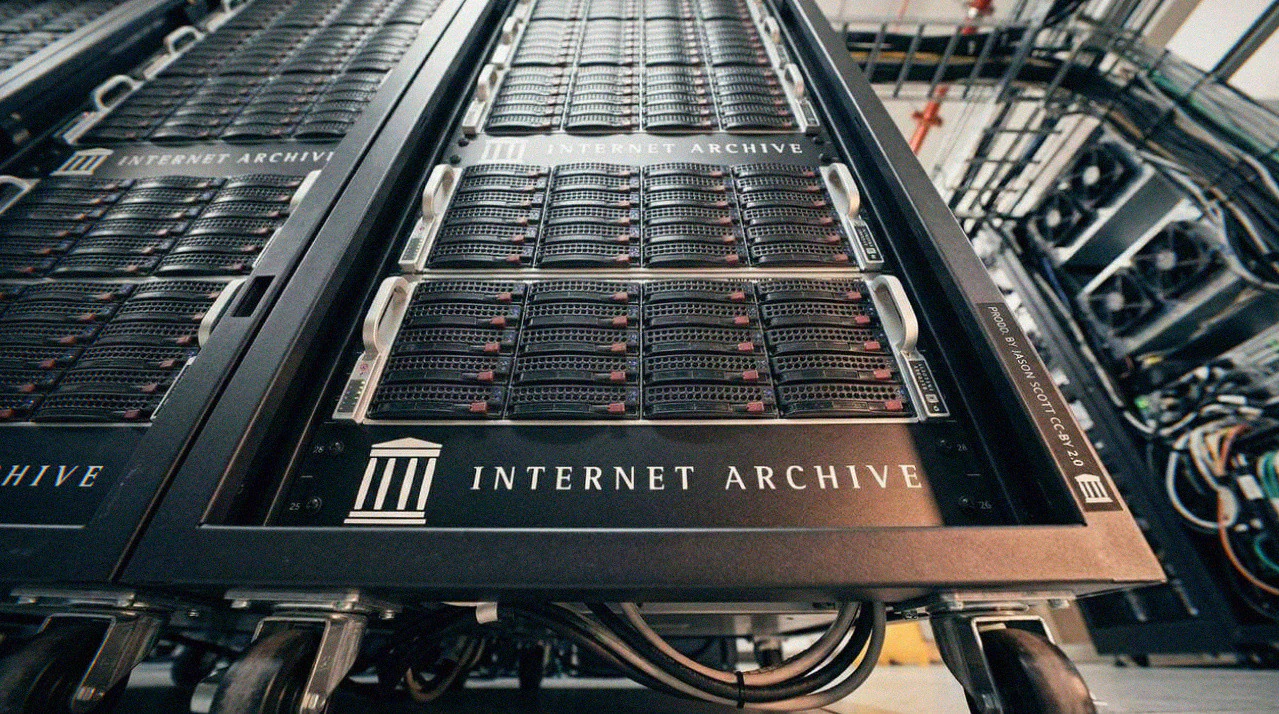

В EFF подчёркивают, что Интернет-архив не строит коммерческие ИИ-системы, а работает как некоммерческая библиотека. Маллин также напоминает о правовой стороне вопроса: суды в США давно признавали, что создание поискового индекса требует копирования материалов, и именно поэтому поиск и архивирование обычно подпадают под добросовестное использование. По его мнению, те же принципы должны защищать и веб-архивы.

Главный тезис EFF прост: борьба с несанкционированным сбором данных для ИИ не должна уничтожать доступ к цифровому прошлому. Если крупные издатели начнут массово закрываться от архивирования, интернет может потерять часть своей документированной истории — не в теории, а на уровне конкретных публикаций, которые уже нельзя будет проверить в исходном виде.

Издатели всё чаще пытаются ограничить автоматический сбор материалов на фоне споров об использовании их контента для обучения ИИ. На этом фоне EFF отделяет коммерческий скрейпинг от работы некоммерческих архивов и библиотек.

Если СМИ продолжат закрывать доступ архивным сервисам, пользователям и исследователям будет сложнее находить ранние версии статей и проверять, как материалы менялись со временем. Для самих архивов это риск потери доступа к новым публикациям и разрывов в сохранённой истории веба.