- Более 200 сотрудников Google и OpenAI подписали открытое письмо в поддержку позиций Anthropic против требований Пентагона.

- Anthropic отказалась применять ИИ-модели для массовой слежки и полностью автономного оружия, установленного Пентагоном ультиматумом.

- Пентагон угрожает разорвать контракт с Anthropic на $200 млн и присвоить компании статус «угрозы цепочке поставок» при несогласии на свои условия.

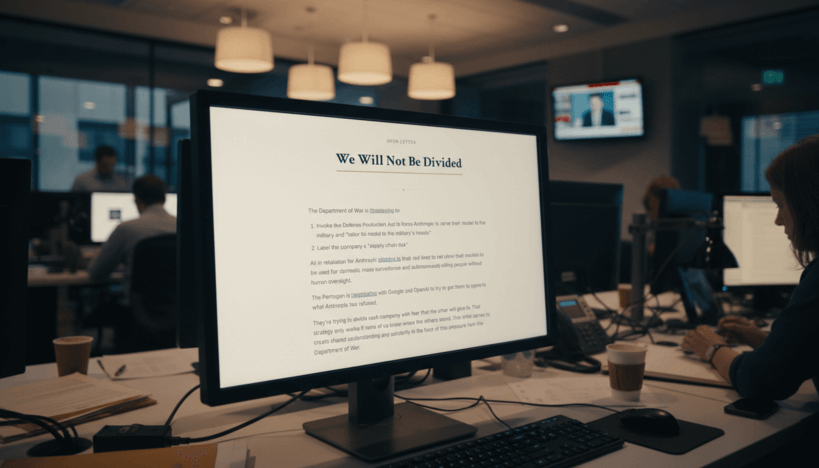

Сотрудники ведущих компаний в сфере искусственного интеллекта выступили в защиту принципов этического использования ИИ в споре между Anthropic и Министерством обороны США. Более 200 работников Google и OpenAI подписали открытое письмо под названием «We Will Not Be Divided», призывающее руководство их компаний ввести жёсткие ограничения на применение ИИ для массовой слежки за гражданами и автономного оружия, аналогичные тем, что установила Anthropic.

Данный шаг является ответом на давление Пентагона, стремящегося заставить Anthropic снять собственные «красные линии» — запреты на использование ее моделей ИИ в военных целях, которые компания ранее установила в рамках переговоров. Пентагон, как отмечают подписавшие письмо, пытается тактикой запугивания и конкуренции разделить участники рынка, убеждая их в неотвратимости уступок.

Конфликт нарастает на фоне ультиматума Министра обороны Пита Хегсета, который дал Anthropic срок до 27 февраля согласиться на условия Пентагона, предусматривающие «любое законное использование» ИИ. В противном случае Пентагон грозит разорвать контракт на $200 млн, присвоить компании статус угрозы национальной цепочке поставок — статус, ранее применявшийся в основном к иностранным компаниям, — или использовать закон о военном производстве для принудительного снятия ограничений.

Anthropic не изменила своей позиции и выразила готовность продолжать переговоры при сохранении двух ключевых запретов: на массовую слежку и полностью автономное оружие. В то же время Google, OpenAI и xAI приняли условия Минобороны, однако далеко не все сотрудники этих компаний разделяют решение руководства, что отражено в коллективных письмах сотрудников, направленных высшему руководству.

Ситуация напоминает внутренний конфликт в Google в 2018 году, где коллектив сотрудников выступил против участия компании в военном проекте Maven, после чего Google отказалась продлевать контракт и ввела запрещающие ИИ для вооружений ограничения, которые в 2025 году сняла. Сейчас Google стала одним из подрядчиков, которые развернули ИИ-платформу Gemini в военной среде Пентагона.

Таким образом, текущее противостояние демонстрирует глубокие разногласия внутри индустрии искусственного интеллекта относительно этического использования технологий в военных целях и подчеркивает важность корпоративной ответственности и общественного контроля над применением ИИ в сферу национальной безопасности.