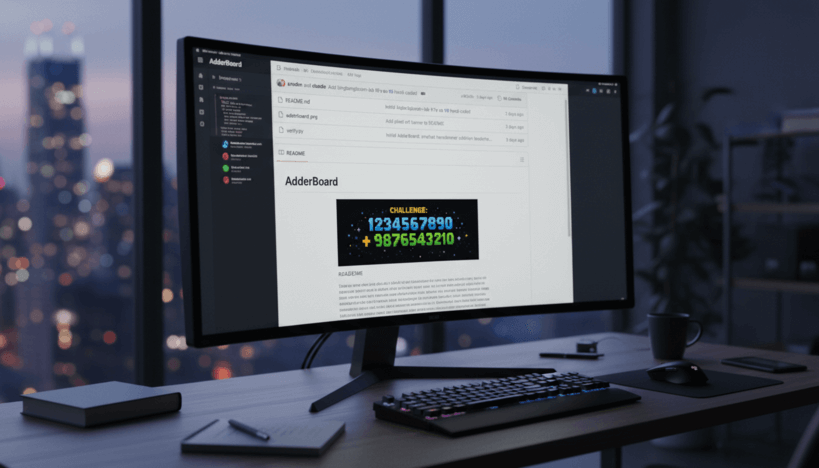

- Участники челленджа AdderBoard создали минимальный трансформер для сложения двух 10-значных чисел с точностью 100% и всего 130 параметрами.

- Исходная модель имела 6 080 параметров, а лучшие обученные модели достигли 311 параметров с точностью 99,999%.

- Ключевые методы включают факторизацию ранга, синусоидальное позиционное кодирование и использование ReLU для обработки переноса при сложении.

Исследовательское сообщество, участвующее в открытом челлендже AdderBoard, продемонстрировало впечатляющий прорыв в миниатюризации трансформеров, способных выполнять арифметические операции. Цель задачи — создать минимальную по размерам модель трансформера, которая способна складывать два 10-значных числа с высокой точностью.

Инициатива началась с эксперимента Димитриса Папаилиопулоса, профессора Висконсинского университета и исследователя Microsoft Research. В феврале он поставил задачу двум ИИ-системам — Claude Code и Codex — обучить трансформер, достигающий не менее 99% точности при сложении 10-значных чисел. Claude Code вернул модель с 6 080 параметрами, а Codex – с 1 644 параметрами. Папаилиопулос опубликовал результаты и открыл лидерборд для всех желающих принять участие в соревновании.

Сообщество быстро откликнулось и смогло вывести модели с существенно меньшим количеством параметров. В настоящее время среди моделей с обучаемыми весами рекорд принадлежит трансформеру, имеющему 311 параметров при точности 99,999%. Ещё более компактная модель – с 130 параметрами – достигла 100%-й точности, однако имеет аналитически заданные веса и служит конструктивным доказательством существования архитектуры, способной представлять сложение.

Для достижения таких результатов использовались продвинутые методы: факторизация ранга 1 и 3, разделение эмбеддингов, синусоидальное позиционное кодирование и специальный механизм обнаружения переноса через функцию активации ReLU. Разработка усложнялась необходимостью решить одновременно три задачи: выравнивание цифр с помощью механизма внимания, поразрядное вычисление с помощью MLP, а также правильное пробрасывание переноса во время авторегрессивной генерации результата.

Любопытно, что исследователи заметили резкий улучшение точности в моделях с размером около 800 параметров, а также то, что однослойные трансформеры при одинаковом числе параметров работают эффективнее двухслойных. В целом, AdderBoard представляет собой уникальное исследование нижней границы возможностей трансформеров в решении нетривиальных арифметических задач.

Лидерборд проекта открыт для участия: любой желающий может предложить свою модель через GitHub, пройти проверку и попасть в таблицу достижений, что способствует коллективному прогрессу в области оптимизации архитектур трансформеров для вычислительных задач.