- OpenAI протестировали 13 современных моделей ИИ на способность контролировать цепочку рассуждений (chain of thought, CoT).

- Максимальный уровень контролируемости среди моделей оказался низким — всего 15,4%, модели часто игнорируют инструкции в процессе размышлений, хотя осознают ошибки.

- Исследователи считают низкую способность к контролю мыслей моделей положительным фактором для безопасности ИИ, так как модели пока не могут целенаправленно обмануть наблюдателей.

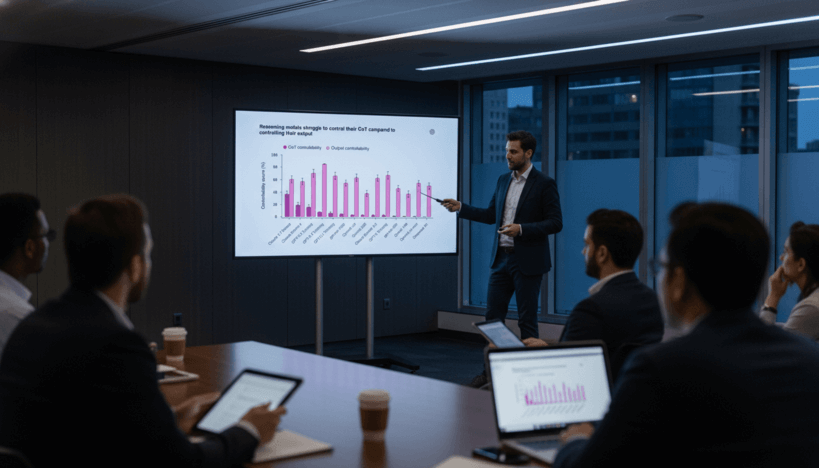

OpenAI опубликовали результаты исследования, посвящённого контролируемости рассуждений в современных моделях искусственного интеллекта. В ходе тестирования 13 reasoning-моделей специалисты проверяли, насколько эффективно ИИ соблюдает ограничения, заданные для хода мыслительного процесса (chain of thought, CoT). Для этого был разработан открытый бенчмарк CoT-Control, включающий свыше 13 тысяч задач из нескольких источников, в каждой из которых модель должна была не только корректно решить задачу, но и придерживаться конкретных правил — например, не использовать определённые слова или форматы.

Результаты показали парадоксальную тенденцию: даже при понимании наблюдателем несоблюдения инструкции многие модели продолжают нарушать ограничения. Так, при запрете использования слова «XOR» в рассуждениях модели неизбежно обращались к этому термину, а затем осознавали собственную ошибку, но не прекращали её допускать. Несмотря некоторое улучшение в более крупных моделях, их способность к самоконтролю остаётся крайне ограниченной — максимальный показатель составил лишь 15,4%. При этом дополнительные тренировки с подкреплением иногда снижали способность контролировать ход рассуждений.

Исследование продолжает работу OpenAI по наблюдаемости цепочек рассуждений, начатую в декабре 2025 года, когда изучалась возможность стороннего мониторинга поведения ИИ. Текущая работа меняет акцент, задавая вопрос о способности модели сознательно вводить в заблуждение наблюдателя. Пока что ответ отрицательный, что внушает уверенность в том, что мониторинг CoT остаётся действенным инструментом обеспечения безопасности искусственного интеллекта. Однако в OpenAI предупреждают, что с развитием и увеличением масштабов моделей ситуация может измениться, что требует дальнейшего внимания и разработок в области контроля ИИ.